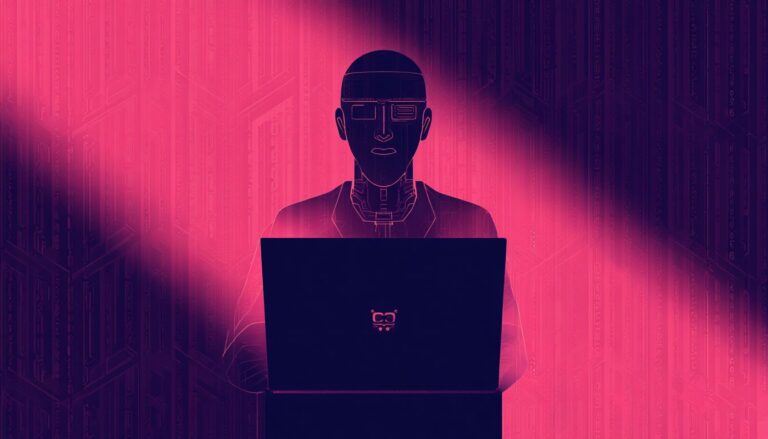

Zagrożenia związane z agentami AI w cyberprzestrzeni

We wrześniu 2025 roku firma Anthropic ujawnila, że państwowy aktor sponsorowany wykorzystał agenta AI do przeprowadzenia autonomicznej kampanii szpiegostwa cybernetycznego przeciwko 30 globalnym celom. AI zrealizowało od 80 do 90% operacji taktycznych samodzielnie, wykonując rekonesans, pisząc kod exploitów oraz próbując ruchu bocznego z prędkością maszyny.

Incydent ten budzi niepokój, ale istnieje jeszcze bardziej niepokojący scenariusz: atakujący, który nie musi przechodzić przez żaden łańcuch zabójstw, ponieważ zyskał dostęp do agenta AI już znajdującego się w Twoim środowisku. Taki agent ma już dostęp, odpowiednie uprawnienia i uzasadniony powód do poruszania się po Twoich systemach każdego dnia.

Ramowy Model Stworzony Z Myślą o Ludzkich Zagrożeniach

Tradycyjny łańcuch zabójstw zakłada, że atakujący muszą zdobywać dostęp krok po kroku. Model ten został opracowany przez firmę Lockheed Martin w 2011 roku, aby opisać, jak przeciwnicy przechodzą od pierwotnego kompromisu do ostatecznego celu, kształtując w ten sposób sposób myślenia zespołów zabezpieczeń o detekcji od tego czasu.

Logika jest prosta: atakujący muszą przejść przez sekwencję kroków, a obrońcy mogą przerwać ten łańcuch w dowolnym momencie. Każdy etap, który musi pokonać atakujący, to kolejna szansa na ich wykrycie.

Etapy intruzji

Typowa intruzja przechodzi przez jasno wyodrębnione etapy:

- Pierwotny dostęp (wykorzystanie luki, itp.)

- Utrzymanie bez wywoływania alertów

- Rekonesans w celu zrozumienia środowiska

- Ruch boczny, aby dotrzeć do cennych danych

- Podniesienie uprawnień, gdy dostęp nie jest wystarczający

- Ekstrakcja przy unikaniu kontroli DLP

Każdy etap stwarza możliwości detekcji: zabezpieczenia końcowe mogą wychwycić pierwotny ładunek, monitorowanie sieci może wykryć nietypowy ruch boczny, systemy tożsamości mogą zauważyć podniesienie uprawnień, a korelacje w SIEM mogą powiązać anomalie w zachowaniach w różnych systemach. Im więcej kroków podejmuje atakujący, tym więcej szans na wykrycie ich działań.

Dlatego zaawansowani aktorzy zagrożeń, tacy jak LUCR-3 i APT29, inwestują znaczne środki w stealth, spędzając tygodnie na zacieraniu się w normalnym ruchu. Nawet wtedy zostawiają ślady: nietypowe lokalizacje logowania, dziwne wzorce dostępu, niewielkie odchylenia od zachowań bazowych. Te artefakty są dokładnie tym, co nowoczesne systemy detekcji są zaprojektowane do znajdowania.

Problem z agentami AI

Problem polega na tym, że agenci AI nie działają zgodnie z tym schematem. Działają fundamentalnie inaczej niż użytkownicy ludzie. Pracują w wielu systemach, przenoszą dane pomiędzy aplikacjami i działają nieprzerwanie. Jeśli dojdzie do ich kompromitacji, atakujący omija cały łańcuch zabójstw – agent staje się łańcuchem zabójstw.

Pomyśl o tym, co typowy agent AI ma do dyspozycji. Jego historia aktywności stanowi idealną mapę istniejących danych i ich lokalizacji. Prawdopodobnie korzysta z Salesforce, przesyła dane do Slacka, synchronizuje z Google Drive oraz aktualizuje ServiceNow w ramach normalnego workflow. Został wyposażony w szerokie uprawnienia podczas wdrożenia, często na poziomie administratora w wielu aplikacjach, i regularnie porusza dane między systemami jako część swojej pracy.

Atakujący, który skompromituje tego agenta, natychmiast dziedziczy wszystko. Zyskuje mapę, dostęp, uprawnienia i uzasadniony powód, aby przemieszczać dane. Każdy etap łańcucha zabójstw, który zespoły zabezpieczeń uczyły się wykrywać przez lata? Agent z automatu pomija wszystkie te etapy.

Aktualne zagrożenia

Kryzys OpenClaw pokazał, jak to wygląda w praktyce:

Około 12% umiejętności na jego publicznym rynku było złośliwych. Krytyczna luka RCE pozwalała na jednoczesny kompromis. Ponad 21 000 instancji było publicznie odkrytych. Ale przerażająca część polegała na tym, co skompromitowany agent mógł uzyskać po połączeniu z Slackiem i Google Workspace: wiadomości, pliki, e-maile i dokumenty, z trwałą pamięcią między sesjami.

Głównym problemem jest to, że narzędzia zabezpieczeń są zaprojektowane do wykrywania anormalnych zachowań. Gdy atakujący korzysta z istniejącego workflow agenta AI, wszystko wydaje się normalne. Agent uzyskuje dostęp do systemów, do których zawsze miał dostęp, przemieszcza dane w sposób, w jaki zawsze to robił, działając w tych samych porach, co wcześniej.

To jest luka w detekcji, przed którą stoją zespoły zabezpieczeń.

Jak Reco Zamyka Lukę W Zasięgu

Ochrona przed skompromitowanymi agentami AI zaczyna się od zrozumienia, które agenty działają w Twoim środowisku, do jakich systemów mają dostęp oraz jakie uprawnienia posiadają. Większość organizacji nie prowadzi inwentaryzacji agentów AI w swoim ekosystemie SaaS. To właśnie po to powstało Reco.

Odkryj Każdego Agenta AI

Bezpieczność Agentic AI Reco odkrywa każdego agenta AI, zintegrowane funkcje AI oraz integracje zewnętrzne AI w całym Twoim środowisku SaaS, w tym narzędzia shadow AI połączone bez zgody IT.

Mapuj Zakres Dostępu i Blast Radius

Dla każdego agenta Reco mapuje, do których aplikacji SaaS ma dostęp, jakie uprawnienia posiada oraz jakie dane może uzyskać. Wizualizacja SaaS-to-SaaS Reco pokazuje dokładnie, jak agenci integrują się w całym ekosystemie aplikacji, ujawniając toksyczne kombinacje, gdzie agenty AI łączą systemy poprzez MCP, OAuth lub integracje API, tworząc luki w uprawnieniach, których żaden właściciel aplikacji by nie zatwierdził.

Oznacz Cele, Wymuszaj Zasady Minimalnych Uprawnień

Reco identyfikuje, które agenty stanowią największe ryzyko, oceniając zakres uprawnień, dostęp między systemami i wrażliwość danych. Agenci związani z nowymi ryzykami są automatycznie oznaczani. Z tej perspektywy Reco pomaga dostosować dostęp poprzez zarządzanie tożsamością i dostępem, ograniczając to, co atakujący może zrobić w przypadku skompromitowania agenta.

Wykrywaj Anomalne Aktywności Agentów

Silnik detekcji zagrożeń Reco stosuje analizy zachowań oparte na tożsamości do agentów AI w taki sam sposób, jak do tożsamości ludzkich, odróżniając normalną automatyzację od podejrzanych odchyleń w czasie rzeczywistym.

Co To Oznacza Dla Twojego Zespołu

Tradycyjny łańcuch zabójstw zakładał, że atakujący muszą walczyć o każdy kawałek dostępu. Agenci AI całkowicie zmieniają to założenie.

Jeden skompromitowany agent może dać atakującemu legalny dostęp, idealną mapę środowiska, szerokie uprawnienia oraz ukrycie w poruszaniu danymi, bez jednego kroku, który przypominałby intruzję.

Zespoły zabezpieczeń, które nadal skupiają się wyłącznie na wykrywaniu działań atakujących ludzi, przegapią tę nową rzeczywistość. Atakujący będą korzystać z istniejącego workflow agentów AI, niewidoczni w szumie normalnych operacji.

Prędzej czy później agent AI w Twoim środowisku stanie się celem. Widoczność jest różnicą między wczesnym wykryciem a odkryciem podczas odpowiedzi na incydent. Reco zapewnia Ci tę widoczność w całym Twoim ekosystemie SaaS w ciągu minut.

Aby dowiedzieć się więcej, odwiedź: Poproś o Demo: Rozpocznij Pracę z Reco.